Chebyshovs Theorem, was es ist, Anwendungen und Beispiele

Das Chebyshovs Theorem (oder Chebyshovs Ungleichung) ist eines der wichtigsten klassischen Ergebnisse der Wahrscheinlichkeitstheorie. Es ermöglicht die Schätzung der Wahrscheinlichkeit eines Ereignisses, das anhand einer Zufallsvariablen X beschrieben wird, indem eine Grenze bereitgestellt wird, die nicht von der Verteilung der Zufallsvariablen, sondern von der Varianz von X abhängt.

Der Satz ist nach dem russischen Mathematiker Pafnuty Chebyshov (auch als Chebychev oder Tchebycheff geschrieben) benannt, der, obwohl er nicht der erste war, der den Satz aufstellte, 1867 als erster einen Beweis erbrachte.

Diese Ungleichung oder solche, die aufgrund ihrer Eigenschaften als Chebyshovs Ungleichung bezeichnet werden, werden hauptsächlich zur Approximation von Wahrscheinlichkeiten durch Berechnung von Grenzen verwendet.

Artikelverzeichnis

- 1 Was macht?

- 2 Anwendungen und Beispiele

- 2.1 Begrenzung der Wahrscheinlichkeiten

- 2.2 Beweis von Grenzwertsätzen

- 2.3 Stichprobengröße

- 3 Ungleichungen vom Typ Chebyshov

- 4 Referenzen

Woraus besteht es?

Bei der Untersuchung der Wahrscheinlichkeitstheorie kommt es vor, dass, wenn die Verteilungsfunktion einer Zufallsvariablen X bekannt ist, ihr Erwartungswert - oder die mathematische Erwartung E (X) - und ihre Varianz Var (X) berechnet werden können, solange solche Beträge existieren . Das Gegenteil ist jedoch nicht unbedingt der Fall..

Das heißt, wenn man E (X) und Var (X) kennt, ist es nicht unbedingt möglich, die Verteilungsfunktion von X zu erhalten, daher sind Größen wie P (| X |> k) für einige k> 0 sehr schwierig zu erhalten. Dank Chebyshovs Ungleichung ist es jedoch möglich, die Wahrscheinlichkeit der Zufallsvariablen abzuschätzen.

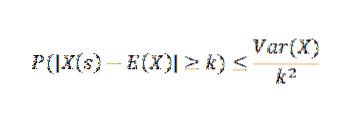

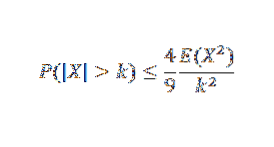

Chebyshovs Theorem besagt, dass wenn wir eine Zufallsvariable X über einen Stichprobenraum S mit einer Wahrscheinlichkeitsfunktion p haben und wenn k> 0 ist, dann:

Anwendungen und Beispiele

Unter den vielen Anwendungen des Chebyshov-Theorems kann Folgendes erwähnt werden:

Wahrscheinlichkeiten begrenzen

Dies ist die häufigste Anwendung und wird verwendet, um eine Obergrenze für P (| X-E (X) | ≥ k) anzugeben, wobei k> 0 ist, nur mit der Varianz und der Erwartung der Zufallsvariablen X, ohne die Wahrscheinlichkeitsfunktion zu kennen.

Beispiel 1

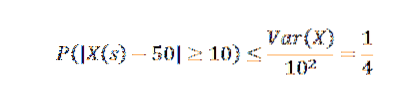

Angenommen, die Anzahl der Produkte, die in einem Unternehmen während einer Woche hergestellt werden, ist eine Zufallsvariable mit einem Durchschnitt von 50.

Wenn bekannt ist, dass die Varianz einer Produktionswoche gleich 25 ist, was können wir dann über die Wahrscheinlichkeit sagen, dass die Produktion in dieser Woche um mehr als 10 vom Mittelwert abweicht??

Lösung

Unter Anwendung von Chebyshovs Ungleichung haben wir:

Daraus können wir ableiten, dass die Wahrscheinlichkeit, dass in der Produktionswoche die Anzahl der Artikel den Durchschnitt um mehr als 10 übersteigt, höchstens 1/4 beträgt.

Beweis von Grenzwertsätzen

Chebyshovs Ungleichung spielt eine wichtige Rolle beim Beweis der wichtigsten Grenzwertsätze. Als Beispiel haben wir folgendes:

Schwaches Gesetz großer Zahlen

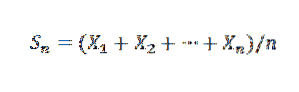

Dieses Gesetz legt fest, dass bei gegebener Folge X1, X2,…, Xn,… unabhängige Zufallsvariablen mit der gleichen Durchschnittsverteilung E (Xi) = μ und Varianz Var (X) = σzwei, und eine bekannte mittlere Stichprobe von:

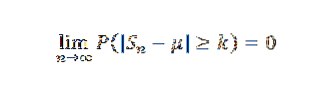

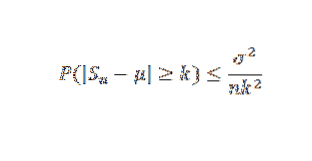

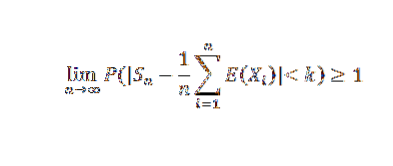

Dann haben wir für k> 0:

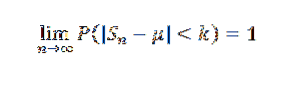

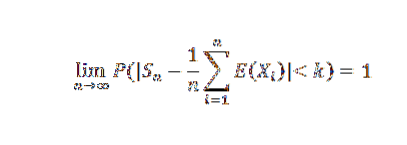

Oder gleichwertig:

Demonstration

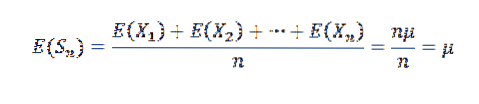

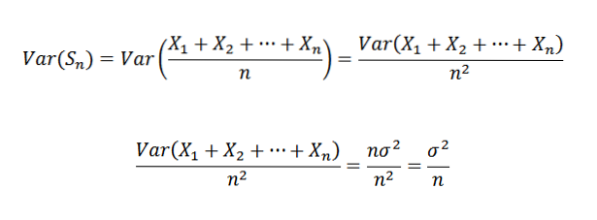

Beachten wir zunächst Folgendes:

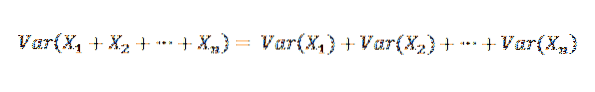

Da X1, X2,…, Xn unabhängig sind, folgt Folgendes:

Daher ist es möglich, Folgendes anzugeben:

Dann haben wir unter Verwendung des Satzes von Chebyshov:

Schließlich ergibt sich der Satz aus der Tatsache, dass die Grenze rechts Null ist, wenn n gegen unendlich tendiert.

Es ist zu beachten, dass dieser Test nur für den Fall durchgeführt wurde, in dem die Varianz von Xi besteht; das heißt, es geht nicht auseinander. Wir beobachten also, dass der Satz immer dann wahr ist, wenn E (Xi) existiert.

Chebyshov-Grenzwertsatz

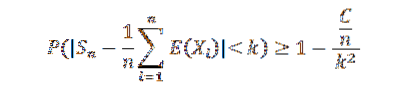

Wenn X1, X2,…, Xn,… eine Folge unabhängiger Zufallsvariablen ist, so dass es ein C gibt< infinito, tal que Var(Xn) ≤ C para todo n natural, entonces para cualquier k>0:

Demonstration

Da die Folge von Varianzen einheitlich begrenzt ist, haben wir Var (Sn) ≤ C / n für alle natürlichen n. Aber wir wissen das:

Wenn n gegen unendlich tendiert, ergeben sich folgende Ergebnisse:

Da eine Wahrscheinlichkeit den Wert 1 nicht überschreiten kann, wird das gewünschte Ergebnis erhalten. Als Konsequenz dieses Satzes könnten wir den besonderen Fall von Bernoulli erwähnen.

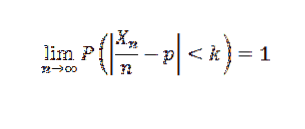

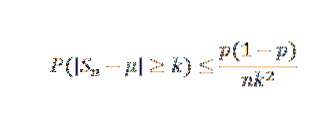

Wenn ein Experiment n-mal unabhängig voneinander mit zwei möglichen Ergebnissen (Misserfolg und Erfolg) wiederholt wird, wobei p die Erfolgswahrscheinlichkeit in jedem Experiment und X die Zufallsvariable ist, die die Anzahl der erzielten Erfolge darstellt, dann haben Sie für jedes k> 0 zu:

Stichprobengröße

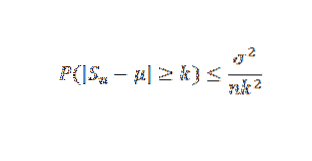

In Bezug auf die Varianz ermöglicht es uns die Chebyshov-Ungleichung, eine Stichprobengröße n zu finden, die ausreicht, um sicherzustellen, dass die Wahrscheinlichkeit, dass | Sn-μ |> = k auftritt, so gering wie gewünscht ist, was uns eine Annäherung an die ermöglicht durchschnittlich.

Genau genommen sei X1, X2, ... Xn eine Stichprobe unabhängiger Zufallsvariablen der Größe n und nehme an, dass E (Xi) = μ und seine Varianz σ istzwei. Durch Chebyshovs Ungleichung haben wir also:

Beispiel

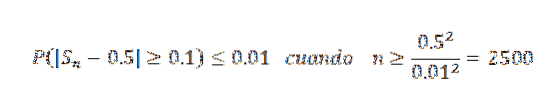

Angenommen, X1, X2,… Xn sind eine Stichprobe unabhängiger Zufallsvariablen mit Bernoulli-Verteilung, so dass sie mit der Wahrscheinlichkeit p = 0,5 den Wert 1 annehmen.

Wie groß sollte die Stichprobe sein, um sicherzustellen, dass die Wahrscheinlichkeit, dass die Differenz zwischen dem arithmetischen Mittel Sn und seinem erwarteten Wert (über mehr als 0,1) liegt, kleiner oder gleich 0, 01 ist??

Lösung

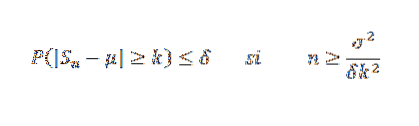

Wir haben, dass E (X) = μ = p = 0,5 und dass Var (X) = σzwei= p (1-p) = 0,25. Durch Chebyshovs Ungleichung haben wir für jedes k> 0:

Wenn wir nun k = 0,1 und δ = 0,01 nehmen, haben wir:

Auf diese Weise wird der Schluss gezogen, dass eine Stichprobengröße von mindestens 2500 erforderlich ist, um sicherzustellen, dass die Wahrscheinlichkeit des Ereignisses | Sn - 0,5 |> = 0,1 kleiner als 0,01 ist.

Ungleichungen vom Typ Chebyshov

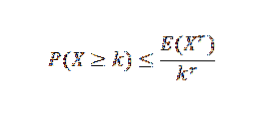

Es gibt mehrere Ungleichheiten im Zusammenhang mit Chebyshovs Ungleichung. Eine der bekanntesten ist die Markov-Ungleichung:

In diesem Ausdruck ist X eine nicht negative Zufallsvariable mit k, r> 0.

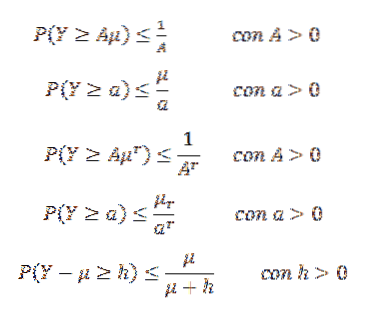

Die Markov-Ungleichung kann verschiedene Formen annehmen. Zum Beispiel sei Y eine nicht negative Zufallsvariable (also P (Y> = 0) = 1) und nehme an, dass E (Y) = μ existiert. Angenommen, auch (E (Y))r= μr existiert für eine ganze Zahl r> 1. Dann:

Eine andere Ungleichung ist Gauß, was uns sagt, dass bei einer unimodalen Zufallsvariablen X mit Modus bei Null dann für k> 0 gilt,

Verweise

- Kai Lai Chung. Elementare Proability-Theorie mit stochastischen Prozessen. Springer-Verlag New York Inc.

- Kenneth.H. Rosen. Diskrete Mathematik und ihre Anwendungen. S. A. MCGRAW-HILL / INTERAMERICANA DE ESPAÑA.

- Paul L. Meyer. Wahrscheinlichkeits- und statistische Anwendungen. S.A. MEXIKANISCHER ALHAMBRA.

- Seymour Lipschutz Ph.D. 2000 Gelöste Probleme der diskreten Mathematik. McGRAW-HILL.

- Seymour Lipschutz Ph.D. Theorie- und Wahrscheinlichkeitsprobleme. McGRAW-HILL.

Bisher hat noch niemand einen Kommentar zu diesem Artikel abgegeben.